وقتی متا کمتر دخالت میکند، چه کسی بهایش را میدهد؟

در سالهای اخیر، کاربران شبکههای اجتماعی بهویژه اینستاگرام و فیسبوک بیش از هر زمان دیگری با یک تناقض عجیب روبهرو شدهاند:

از یکسو، بعضی محتواهای مخرب، توهینآمیز یا حتی خطرناک بدون هیچ محدودیتی منتشر میشوند؛

و از سوی دیگر، پیجهایی کاملاً عادی و حتی حرفهای، ناگهان با ریپورت، محدودیت یا دیسیبل شدن مواجه میشوند، بدون اینکه دلیل روشنی دریافت کنند.

متا در جدیدترین گزارش «اجرای استانداردهای اجتماعی» خود، سعی کرده به این تناقض پاسخ دهد. این شرکت مدعی است که سیاستهای نظارتیاش «دقیقتر»، «کمخطاتر» و «منصفانهتر» شدهاند. اما سؤال اصلی برای کاربران ایرانی این است:

آیا این تغییرات واقعاً به نفع پیجهاست، یا فقط صورتمسئله عوض شده؟

برای پاسخ به این سؤال، باید یک تصمیم کلیدی متا را دقیق بررسی کنیم؛ تصمیمی که نقطهی شروع بسیاری از اتفاقات امروز است:

خروج از Fact-Checking متمرکز و حرکت به سمت Community Notes.

چرا متا مسیر کنترل محتوا را عوض کرد؟

از Fact-Checking تا Community Notes

متا در ابتدای سال میلادی اعلام کرد که ساختار نظارت بر محتوا در پلتفرمهایش را تغییر میدهد. بهصورت رسمی، همکاری با نهادهای Fact-Checking شخص ثالث کاهش یافت و جای آن را مدلی گرفت که متا آن را «Community Notes» مینامد؛ مدلی که پیشتر در پلتفرم X (توییتر سابق) دیده بودیم.

استدلال رسمی متا چه بود؟

مارک زاکربرگ صراحتاً اعلام کرد که:

- سیستم قبلی بیش از حد سختگیرانه بوده

- حجم بالایی از محتوا بهاشتباه حذف یا محدود میشده

- کاربران احساس میکردند «صدایشان شنیده نمیشود»

راهحل پیشنهادی متا ساده به نظر میرسید:

بهجای تصمیمگیری از بالا، اجازه دهیم کاربران در تشخیص محتوا نقش داشته باشند.

در مدل Community Notes:

- محتوا لزوماً حذف نمیشود

- بلکه ممکن است با توضیح، هشدار یا یادداشت جمعی همراه شود

- و قضاوت نهایی تا حدی به جامعهی کاربران واگذار میشود

روی کاغذ، این مدل دموکراتیکتر است. اما در عمل، ماجرا پیچیدهتر میشود بهخصوص برای کشورهایی مثل ایران.

ترجمهی این تصمیم برای کاربران ایرانی چیست؟

کاربر ایرانی در یک اکوسیستم «نابرابر» فعالیت میکند:

- دسترسی مستقیم به پشتیبانی متا ندارد

- در بسیاری موارد، زبان و لوکیشنش بهعنوان سیگنال پرریسک تلقی میشود

- و بیش از کاربران کشورهای غربی، در معرض ریپورت گروهی و رفتارهای سازمانیافته است

در چنین شرایطی، وقتی متا میگوید:

«ما کمتر دخالت میکنیم»

ترجمهی عملی آن برای بسیاری از پیجهای ایرانی این است:

- اگر مورد حملهی فیکاکانتها قرار بگیری، سیستم کمتر وارد عمل میشود

- اگر محتوای تو توسط رقبا یا هیتِرها ریپورت شود، تصمیمها بیشتر بر اساس الگوی رفتاری گذشتهی پیج گرفته میشود

- و اگر هویت دیجیتال شفافی نداشته باشی، احتمال اشتباه سیستم بالاتر میرود

یک نکتهی کلیدی که متا مستقیم نمیگوید

Community Notes فقط یک تغییر «نظارتی» نیست؛

این مدل بهطور ضمنی به متا اجازه میدهد مسئولیت مستقیم حذف یا عدم حذف محتوا را کمتر بر عهده بگیرد.

یعنی:

- اگر محتوای مخربی باقی بماند، میتوان گفت «کاربران واکنش نشان ندادهاند»

- اگر پیجی آسیب ببیند، میتوان گفت «سیستم بر اساس سیگنالها تصمیم گرفته»

برای متا، این یک مدیریت ریسک حقوقی و سیاسی است.

اما برای کاربران، مخصوصاً در بازارهای حساس، این یعنی:

بقا دیگر فقط به قوانین نوشتهشده بستگی ندارد؛

به «درک الگوریتم از تو» بستگی دارد.

دقت ۹۰٪ متا؛ عددی دقیق یا روایتی هوشمندانه؟

متا در گزارش جدید خود با اعتمادبهنفس اعلام میکند که سیستمهای اجراییاش به «دقت بالای ۹۰٪» رسیدهاند.

در نگاه اول، این عدد امیدوارکننده به نظر میرسد: یعنی از هر ۱۰ محتوایی که حذف میشود، ۹ تای آن «درست» حذف شدهاند.

اما اینجا همان نقطهای است که باید مکث کرد.

چون دقت (Precision) الزاماً به معنی عدالت، امنیت یا کیفیت تجربه کاربر نیست.

متا دقیقاً چه چیزی را اندازهگیری میکند؟

وقتی متا میگوید:

«Enforcement Precision بالای ۹۰٪»

منظورش این است:

- از میان محتواهایی که حذف شدهاند،

- چه درصدی واقعاً ناقض قوانین بودهاند.

اما چیزی که گفته نمیشود این است:

- چه مقدار محتوا اصلاً بررسی نشده

- چه مقدار تخلف نادیده گرفته شده

- و چه تعداد پیج بهدلیل «ریسکپروفایل» زودتر قربانی شدهاند

به زبان سادهتر:

اگر سیستم کمتر حذف کند، احتمال خطا هم بهطور طبیعی کمتر دیده میشود.

چرا کاهش حذف محتوا، آمار خطا را زیباتر میکند؟

فرض کن یک سیستم در گذشته:

- روزانه ۱۰۰۰ محتوا را حذف میکرد

- و ۱۰۰ مورد اشتباه بود (۱۰٪ خطا)

حالا همان سیستم:

- فقط ۳۰۰ محتوا را حذف میکند

- و ۳۰ مورد اشتباه دارد (همان ۱۰٪ واقعی)

در گزارش چه دیده میشود؟

- حذف کمتر

- اعتراض کمتر

- و تصویری از «بهبود دقت»

در حالی که واقعیت این است:

سیستم فقط کمکارتر شده، نه الزاماً باهوشتر

این دقیقاً همان چیزی است که در دادههای متا دیده میشود، مخصوصاً وقتی به نمودارهای Proactive Detection نگاه میکنیم (که در بخش بعدی عمیقتر بررسی میکنیم).

این عدد برای کاربر ایرانی چه معنایی دارد؟

برای پیجهای ایرانی، «دقت بالا» همیشه خبر خوب نیست. چرا؟

چون:

- سیستم متا برای کاهش خطا، ریسکگریزتر شده

- یعنی وقتی به یک پیج شک کند، ترجیح میدهد سریع تصمیم بگیرد

- نه اینکه وارد بررسی انسانی عمیق شود

در نتیجه:

- پیجهایی با هویت شفاف، سابقه سالم و سیگنالهای پایدار → کمتر آسیب میبینند

- پیجهایی با رفتار نامنظم، تغییر مالکیت، یا تعامل مشکوک → زودتر قربانی میشوند

و اینجا دقیقاً همان نقطهای است که کاربران ایرانی بیشتر ضربه میخورند:

- تغییر IP

- تغییر دستگاه

- تغییر لوکیشن

- استفاده از ادمینهای متعدد

- یا حتی رشد ناگهانی غیرطبیعی

همهی اینها برای الگوریتم، «ابهام مالکیت» ایجاد میکند.

کاهش شکایت کاربران؛ شاخص واقعی موفقیت؟

متا یکی از نشانههای موفقیت مدل جدید را این میداند که:

«کاربران کمتر از حذف اشتباه شکایت میکنند»

اما این شاخص یک مشکل اساسی دارد:

- بسیاری از کاربران اصلاً نمیدانند چرا پیجشان محدود شده

- یا راهی برای اعتراض مؤثر ندارند

- یا حتی متوجه حذف یا افت دسترسی نمیشوند

در ایران، این مسئله شدیدتر است:

- نبود دسترسی به پشتیبانی واقعی

- محدودیت زبان

- و تفاوت قوانین منطقهای

پس «کمتر شدن شکایت» لزوماً به معنی «بهتر شدن تجربه» نیست؛

گاهی فقط به معنی کمشنیدهشدن صداهاست.

وقتی سیستم کمتر میبیند: کاهش شناسایی خودکار و افزایش محتوای مخرب

یکی از مهمترین بخشهای گزارش متا—که معمولاً در تیترها گم میشود—نمودارهای مربوط به Proactive Detection است؛ یعنی میزان شناسایی و اقدام خودکار سیستم، بدون اینکه کاربر گزارشی ثبت کند.

اینجا دقیقاً همانجاست که روایت «دقت بالاتر» ترک برمیدارد.

Proactive Detection یعنی چه؟

به زبان ساده، Proactive Detection یعنی:

- سیستم قبل از اینکه کسی گزارش بدهد

- تخلف را تشخیص دهد

- و وارد عمل شود (حذف، محدودسازی یا هشدار)

این همان چیزی است که سالها متا روی آن سرمایهگذاری کرده بود:

هوش مصنوعیای که «زودتر از انسان» خطر را تشخیص دهد.

اما طبق گزارش جدید، این شاخص در چند حوزهی حساس بهطور محسوسی افت کرده است.

افت ۲۰٪؛ عددی که نباید ساده از کنارش گذشت

در حوزهی Bullying & Harassment (آزار و اذیت، توهین، حملهی کلامی):

- میزان شناسایی و اقدام خودکار متا حدود ۲۰٪ کاهش یافته

در حوزهی Hateful Conduct (نفرتپراکنی):

- افت ناگهانی و قابلتوجه دیده میشود

- آن هم در بخشی که از نظر تاریخی، یکی از پرریسکترین حوزههای شبکههای اجتماعی بوده

این یعنی چه؟

یعنی:

محتوایی که سیستم قابلیت تشخیصش را دارد،

عمداً کمتر متوقف میشود.

نه بهخاطر ناتوانی فنی،

بلکه بهخاطر تغییر سیاست.

چرا متا عمداً کمتر دخالت میکند؟

در چارچوب مدل Community Notes:

- حذف مستقیم محتوا، آخرین گزینه است

- ترجیح داده میشود «واکنش اجتماعی» شکل بگیرد

- نه «تصمیم ماشینی از بالا»

این تصمیم برای متا مزایای مهمی دارد:

- کاهش فشار سیاسی و رسانهای

- کاهش اتهام سانسور

- کاهش مسئولیت حقوقی

اما هزینهاش را چه کسی میدهد؟

کاربران.

ترجمه این سیاست برای فضای ایران

اینجا باید کاملاً واقعبین باشیم.

فضای کاربری ایران با آمریکا یا اروپا یکی نیست.

در ایران:

- ریپورتها اغلب گروهی و هدفمند هستند

- فیکاکانتها نقش فعال دارند

- رقابتها شخصیتر و مخربتر است

- و بسیاری از حملات، زیر خط قرمزهای واضح متا حرکت میکنند

وقتی سیستم:

- کمتر بهصورت پیشدستانه دخالت میکند

- و منتظر «واکنش جامعه» میماند

نتیجه برای پیجهای ایرانی چیست؟

- توهینها بیشتر دیده میشوند

- حملات فرسایشی طولانیتر میشوند

- و فشار روانی روی صاحب پیج افزایش پیدا میکند

اما نکتهی مهمتر:

سیستم، همهی اینها را سیگنال رفتاری پیج ثبت میکند.

پارادوکس خطرناک: محتوای مخرب میماند، پیج آسیب میبیند

اینجا یک تناقض ظریف اما مهم شکل میگیرد:

- محتوای مخرب سریع حذف نمیشود

- اما واکنشهای اطراف آن (ریپورت، درگیری، پاسخ احساسی) ثبت میشود

در نتیجه:

- پیجی که مورد حمله قرار گرفته

- اگر واکنش ناپایدار یا احساسی نشان دهد

- ممکن است خودش بهعنوان «مسئلهدار» شناخته شود

این همان جایی است که خیلی از پیجهای ایرانی میگویند:

«من که کاری نکرده بودم، چرا پیجم محدود شد؟»

پاسخ ساده نیست، اما واقعی است:

سیستم به زمینه رفتاری نگاه میکند، نه فقط به یک پست.

کاهش شناسایی خودکار، چه چیزی را پررنگتر میکند؟

وقتی Proactive Detection پایین میآید:

- نقش سابقه پیج پررنگتر میشود

- نقش هویت مالک پررنگتر میشود

- و نقش الگوهای رفتاری تاریخی تعیینکنندهتر میشود

یعنی:

- پیجهای قدیمی، معتبر، با رفتار پایدار → تابآورتر

- پیجهای تازه، تغییرمالکداده، یا بیهویت → آسیبپذیرتر

این دقیقاً همان نقطهای است که مفهوم «هویت دیجیتال» از یک بحث تئوریک، تبدیل به مسئلهی بقا میشود.

فقط ۴٪؟ چرا اکانتهای فیک تهدید اصلی پیجهای واقعی هستند

در گزارش رسمی متا آمده است که حدود ۴٪ از کاربران فعال ماهانه در پلتفرمهای این شرکت، اکانتهای فیک هستند.

در نگاه اول، این عدد ممکن است ناچیز به نظر برسد. چهار درصد یعنی چه؟ تقریباً هیچ.

اما وقتی این عدد را در مقیاس متا ضرب کنیم، داستان کاملاً عوض میشود.

متا بیش از ۳.۵ میلیارد کاربر فعال ماهانه دارد.

۴٪ از این عدد یعنی بیش از ۱۴۰ میلیون اکانت جعلی که متا رسماً وجود آنها را تأیید میکند.

و این فقط آن بخشی است که شناسایی یا برآورد شده؛ نه الزاماً تمام واقعیت.

اکانت فیک دقیقاً یعنی چه؟

در گذشته، تعریف اکانت فیک ساده بود:

- پروفایل بدون هویت واقعی

- عکس دزدی

- فعالیت محدود یا مشکوک

اما امروز، ماجرا پیچیدهتر شده است:

- باتها

- اکانتهای اجارهای

- اکانتهای فارمشده

- و حتی پروفایلهای مبتنی بر هوش مصنوعی

جالب اینجاست که خود متا در حال آزمایش پروفایلهای AI است؛ حسابهایی که مثل انسان تعامل میکنند.

اینجا یک سؤال جدی مطرح میشود:

آیا همهی اینها فیک محسوب میشوند؟ یا فقط بخشی از آنها؟

پاسخ متا شفاف نیست و همین ابهام، خطر را بیشتر میکند.

چرا فیکاکانتها برای پیجهای ایرانی خطرناکترند؟

در بسیاری از کشورها:

- فیکاکانت بیشتر برای اسپم تبلیغاتی استفاده میشود

- یا تعامل مصنوعی

اما در فضای ایران:

- فیکاکانتها ابزار فشار، تهدید و حذف هستند

کاربردهای رایج:

- ریپورت گروهی هماهنگ

- هیت سازمانیافته

- تخریب اعتبار پیج

- ایجاد سیگنال رفتاری منفی برای الگوریتم

و این دقیقاً همان جایی است که سیاست جدید متا مشکلساز میشود.

وقتی متا میگوید «۴٪»، الگوریتم چه میفهمد؟

الگوریتم متا با منطق «احتمال» کار میکند، نه قطعیت.

یعنی:

- اگر بداند درصدی از کاربران فیک هستند

- اما رفتار آنها شبیه کاربران واقعی باشد

- سیستم آنها را بهعنوان «سیگنال معتبر» ثبت میکند

بهخصوص وقتی:

- تعاملها پراکنده ولی مداوم باشند

- ریپورتها از حسابهای مختلف بیایند

- و پیج هدف، سابقهی مبهمی داشته باشد

در این شرایط:

الگوریتم به ریپورتها شک نمیکند؛

به پیج شک میکند.

نقش سابقه و هویت دیجیتال در برابر فیکاکانتها

اینجا تفاوت بین دو پیج مشخص میشود:

پیج A:

- سابقه فعالیت طولانی

- الگوی رفتاری پایدار

- ارتباط با منابع معتبر

- سیگنالهای هویتی مشخص

پیج B:

- تغییرات ناگهانی

- رشد مشکوک

- ادمینهای متعدد

- نبود پیوند هویتی روشن

حالا اگر هر دو مورد حمله فیکاکانتها قرار بگیرند:

- پیج A احتمالاً محدود نمیشود

- پیج B بهعنوان «ریسک بالقوه» علامتگذاری میشود

نه بهخاطر گناه،

بلکه بهخاطر نبود اعتماد الگوریتمی.

متا همه فیکها را حذف نمیکند؛ چرا؟

این نکته شاید تلخ باشد، اما واقعی است:

- حذف کامل فیکاکانتها از نظر فنی و اقتصادی ممکن نیست

- برخی فیکها تعامل ایجاد میکنند

- و تعامل، سوخت الگوریتم است

در نتیجه:

متا بهجای حذف همهی فیکها،

تلاش میکند اثر آنها را مدیریت کند.

و این مدیریت، ناخواسته فشار را به پیجهای ضعیف منتقل میکند.

چه چیزی واقعاً دیده میشود؟

چرا لینک، سیاست و حتی برندها در الگوریتم متا میبازند

در کنار گزارش حذف محتوا و اکانتهای فیک، متا یک گزارش دیگر هم منتشر میکند که برای خیلیها—بهخصوص دیجیتالمارکترها—ناامیدکننده است:

Widely Viewed Content Report

گزارشی که نشان میدهد کاربران واقعاً چه چیزهایی را در فیسبوک میبینند.

این گزارش یک هدف قدیمی دارد:

رد این اتهام که الگوریتمهای متا، محتوای سیاسی، افراطی یا تفرقهانگیز را تقویت میکنند.

اما دادهها، چیز مهمتری را لو میدهند.

متا میگوید مردم دنبال چه هستند؟

طبق این گزارش:

- بیشترین دیدهشدن مربوط به خبرهای ترند روز

- داستانهای واقعی زندگی

- اتفاقات احساسی و کنجکاویبرانگیز

- مرگ چهرههای مشهور

- اتفاقات غیرسیاسی اما «قابل حرف زدن»

نه بیانیههای سیاسی

نه تحلیلهای عمیق

نه حتی محتوای برندی کلاسیک

به زبان ساده:

الگوریتم متا عاشق «روایت انسانی» است، نه پیام.

این داده چرا برای بازار ایران مهم است؟

در فضای ایران، بسیاری از پیجها هنوز با منطق قدیمی کار میکنند:

- لینک بده

- فروش مستقیم کن

- پیام تبلیغاتی تکرار کن

- یا محتوا را «اعلامیهای» منتشر کن

اما دادههای متا میگویند:

این نوع محتوا، اساساً دیده نمیشود.

و این فقط یک حس نیست؛ عدد دارد.

سقوط تاریخی Link Posts؛ زنگ خطر برای همه

یکی از مهمترین نمودارهای گزارش متا:

- سهم پستهای لینکدار از کل محتوای دیدهشده

- که از ۹.۸٪ در سال ۲۰۲۲ رسیده به زیر ۳٪

- و در فصل اخیر حتی به حدود ۲٪

این یعنی چه؟

یعنی:

- فیسبوک (و تا حدی اینستاگرام)

- دیگر موتور ترافیک نیستند

- بلکه موتور «درگیری احساسی و رفتاری» هستند

اگر هدفت فقط این است که:

کاربر را از پلتفرم خارج کنی

الگوریتم با تو همراهی نمیکند.

چرا برندها هم در این فضا میبازند؟

برندها معمولاً:

- پیام دارند

- هدف دارند

- CTA دارند

- و ساختار دارند

اما الگوریتم متا:

- ساختار را دوست ندارد

- پیشبینیپذیری را دوست ندارد

- و محتوای «طراحیشده برای فروش» را پس میزند

در عوض، چیزی را بالا میبرد که:

- طبیعی به نظر برسد

- انسانی باشد

- و شبیه رفتار واقعی کاربران عادی باشد

اینجا همان نقطهای است که:

برند اگر «انسانی» نشود، نامرئی میشود.

پیوند این بخش با امنیت پیج و هویت دیجیتال

شاید در نگاه اول، این گزارش فقط محتوایی به نظر برسد.

اما یک لایهی عمیقتر دارد.

وقتی:

- لینکها دیده نمیشوند

- پیامهای مستقیم فروش دیده نمیشوند

- و برندها مجبورند غیرمستقیم رفتار کنند

آنچه باقی میماند چیست؟

«الگوی رفتاری پیج»

یعنی:

- چه چیزی پست میکنی

- چطور واکنش میگیری

- چه کسانی تعامل میکنند

- و این رفتارها در طول زمان چقدر پایدارند

و این دقیقاً همان چیزی است که الگوریتم متا برای:

- اعتماد

- تشخیص مالکیت

- و تصمیمهای حساس (محدودیت، دیسیبل، بازگردانی)

از آن استفاده میکند.

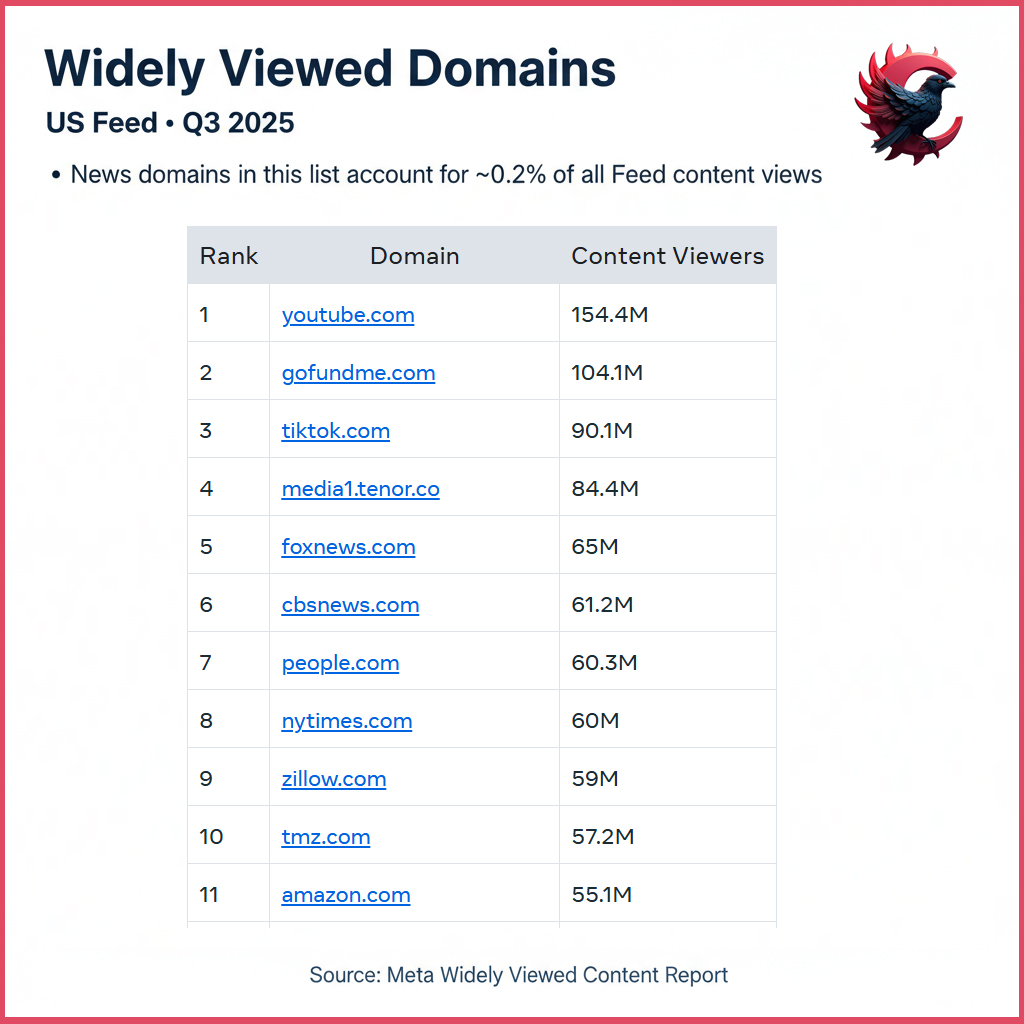

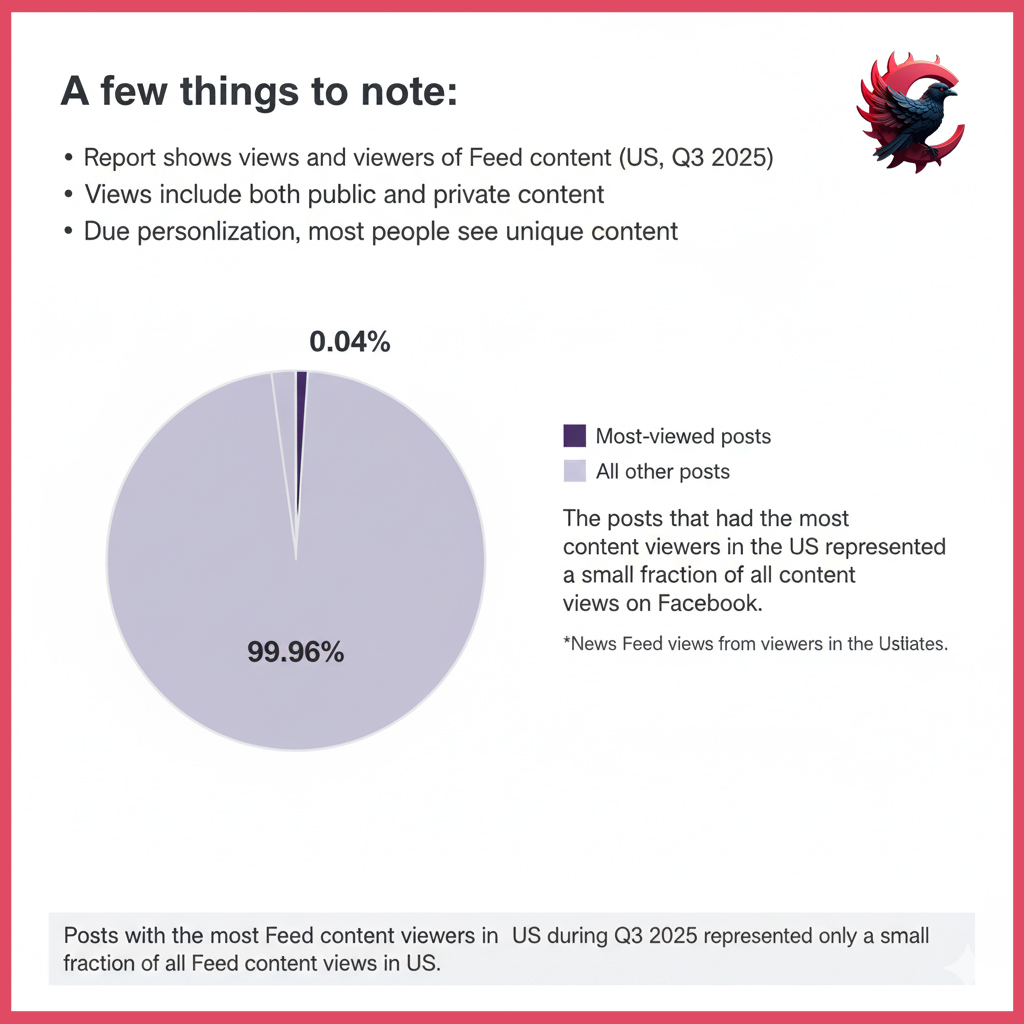

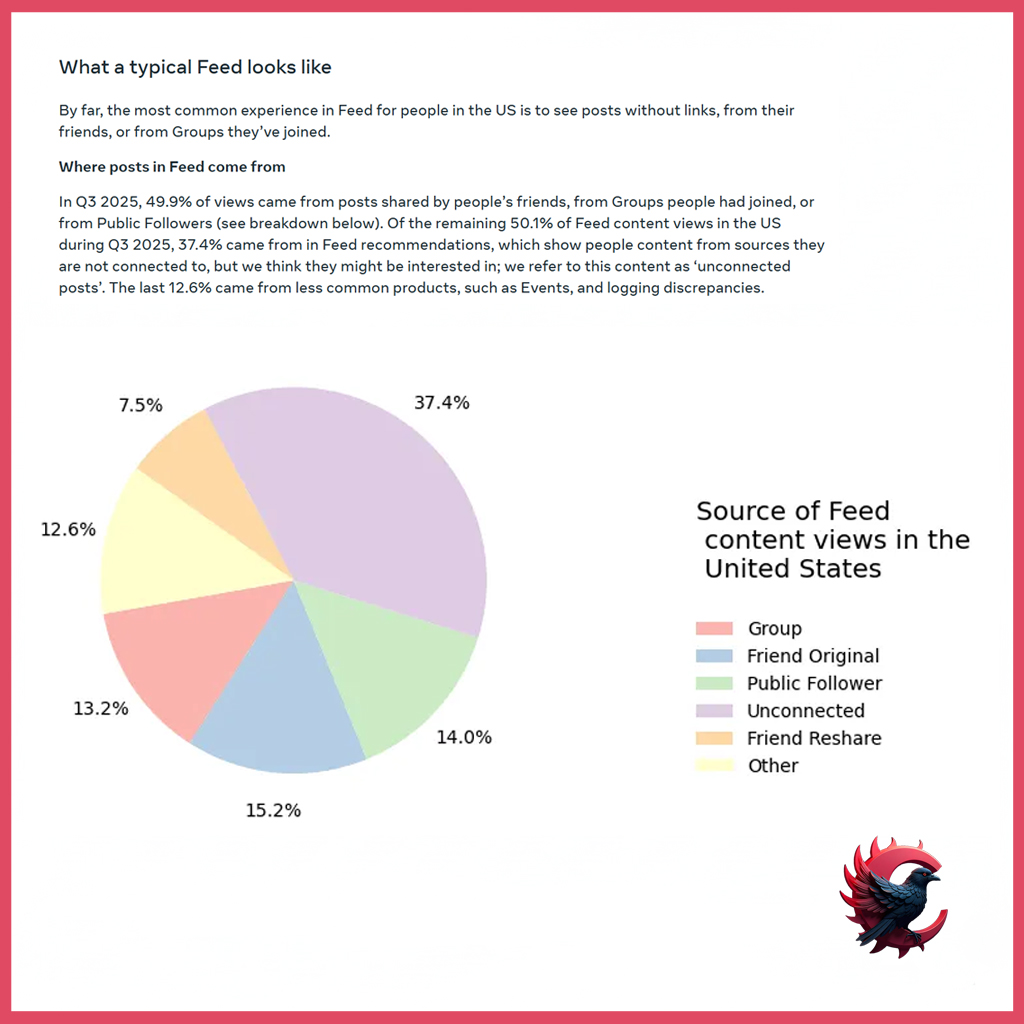

آماری که متا در سایت خود گزارش داده است به شرح زیر است:

- مقاله های مرتبط :

- چطور پیجها پرخطر در اینستاگرام علامتگذاری میشوند؟

- چطور اینستاگرام از رفتار گذشته برای تصمیمگیری در بازگردانی استفاده میکند؟

بنیانگذار و مدیرعامل آژانس سی پرشین، متخصص در برندسازی شخصی و سازمانی، و فعال در حوزه استراتژیهای دیجیتال. با سالها تجربه در حوزه رسانه، سئو، و تولید محتوای تخصصی، جواد همواره تلاش میکند تا مسیر دیدهشدن و اعتبارسازی برای برندها و افراد را هموار کند. او همچنین نویسنده و مشاور پروژههای بینالمللی در زمینه انتشار مقالات در رسانههای معتبر جهانی است.